小红书AMA

1024,下班后就直接去小红书新工区LuOne凯德晶萃广场办公楼。在一线城市就是这点好,有时候前一天或者当天看到一些活动,都可以直接去,如果想的话,可以每周末都排得满满的

刚好他们公司也在举办1024活动,一眼看到是参与活动盖章的那一套,大厅还有一对宇树的狗和机器人,今天恰好也是他们的宠物日,看到一只超大的萨摩,居然害怕宇树的狗,引来大家的围观和哄笑。

现在公司的流程都有点相似,员工预先登记访客信息,到了签到得到进入的凭证。基本上都只会在访问区域,通常不会去办公区。

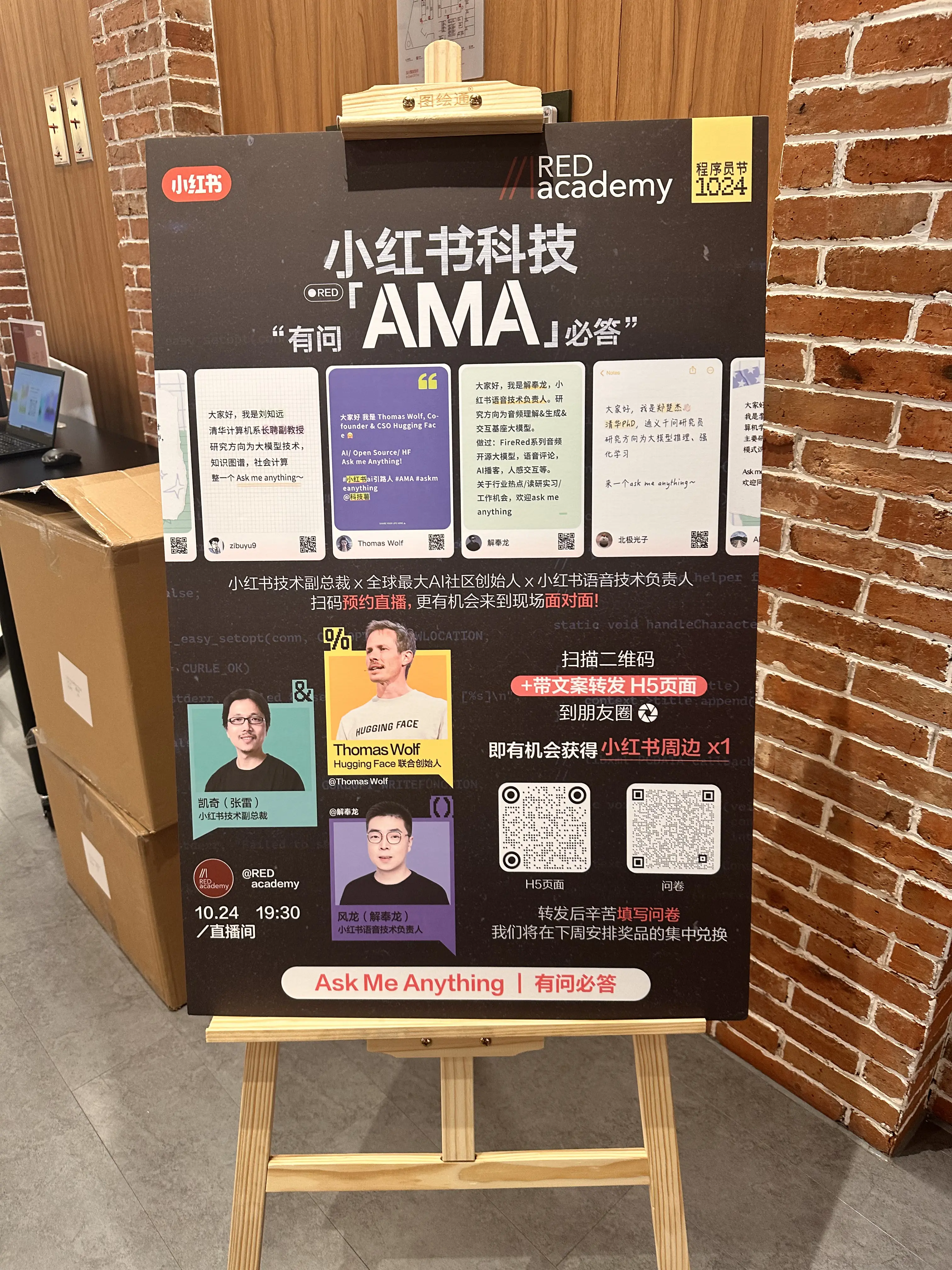

进入到活动现场,已经坐满人了,看了一下,大部分是小红书自家的同学,二十来个是外面来访的朋友。这次AMA主要有凯奇(张雷,小红书技术副总裁),风龙(解奉龙,小红书语音技术负责人),Thomas Wolf(Hugging Face联合创始人)三个人。

补充一下背景信息:

- 这次活动是小红书和REDacademy一起办的,REDacademy是小红书内部为员工设立的跨界成长课程,旨在通过邀请各领域的顶尖学者和实践者,为员工提供多元化的学习机会,激发创新思维。是2025年宣布的员工成长计划之一(另外一个是领导力培养项目REDFellow Program)。

- 另外AMA(Ask Me Anything,有问必答)是这几个月在小红书走红的一个算是破圈了的话题,主要以科技圈的大佬和专家下场,带动了很多相关人士发AMA笔记,也一改人们对于小红书主要集中集美们和生活类的话题为主的平台基调,也能看到小红书在话题活了之后有意助推和扶持这一趋势,或许有可能成为小红书内容的另一条增长曲线

PS:AMA这个页面下面的笔记里的评论,认真去看是有很多高质量的内容的,AMA这个话题还是非常不错的

坐下后发现还配备了翻译机,回头看了一下隔音小屋子里有两位同声翻译员,一下子把level拉起来了。因为Thomas堵在路上(现实感受一下SH的周五晚高峰?),主持人小姐姐和两位小红书的两位老师热场中,倒是也让我们来访的人了解了一些小红书在内容、AI相关领域的一些咨询。Thomas到位后也正式开始了。这次的形式主要是QA,一趴是提前收集到的问题由主持人小姐姐发问,另一趴是现场观众提问。主持人小姐姐长得很好看,不过似乎访谈技巧还有一定的提升空间😊。另外感觉筹备组提前收集准备的问题似乎不完全make sense,不过问题倒也是不大,重要的还是听三位老师的字里行间的一些想法和见解。

废话了那么多,以时间线推进的,现在聊一下我记下来的几点比较有趣的东西: 1️⃣ 开源&闭源模型的话题,毕竟hf也是做模型开源社区的,不难理解有这个问题。开源和闭源的差距在拉近。另外现在模型的开源和原来以GitHub为主的代码开源不太一样,现在的开源主要是针对模型的权重(weights),大家也没办法基于这个权重去一起贡献和改变权重,只能说基于权重再去做类似微调、强化学习等,大家更关注的是技术报告,里面披露的训练的方法、思路和细节 2️⃣ 小红书两位老师也有表示小红书也做了一些模型的开源,包括FireRed、dots-ocr等,一个角度:模型的效果仅靠benchmark来评估效果不太够,无法代表实际的应用效果,因此开源的好处之一是可以收到来自社区的实际应用反馈,有助于从更广泛的角度去看模型的效果,为后续的训练和调优指明方向。另外值得一提的是dots-ocr的效果确实非常好,很多adoption 3️⃣ 关于语音模型,训练数据远远少于文本数据,虽然今年一些头部公司的语音模型的训练数据规模已经达到了几千万、上亿小时的级别,但是与文本数据相比仍然有很大的差距。所以语音模型还有很大的进步空间,其中很重要的一个点在于数据不足,还能继续走scaling-law的路。现在小红书也在内测语音评论的功能,小红书也会基于语音模型去识别说话的内容、预期、情感等内容。在这次活动之前我不知道小红书有这个功能在内测,结合今天的分享内容,我腹黑一下,小红书借助这个功能可以有更多的语音数据做训练,功能本身也提供了一个大型的Evaluation现场,善加利用可以有一定程度的数据飞轮效果。记忆犹新,Thomas说了一句你们非常幸运有这么多的数据(指小红书这个平台这么多的数据),总感觉他说这句话适合的语气和神情很有内味(笑 4️⃣ 我刚好提问了风龙老师一个问题,现在一些场景比如同声传译的,需要将语音转文本(stt),文本转文本翻译(ttt),文本转语音(tts),怎么看待sts这种端到端的模型呢?风龙老师做了一个挺详细的解析和他的见解,我觉得讲的很好。关键的点就是不稳定性很高,也就是现在的流程稳定性很高,相对更可靠,哪个环节有问题都能比较明确的知道,但是如果端到端的话,出问题了有可能不知道怎么解决,这种对于企业生产级别的服务,是完全不可接受的,基本上方案也很难能通过。我理解可能还是端到端模型的不可解释性太高,以及目前这个模型的发展还没有到位。我记得amazon好像就有这块的探索。风龙老师也讲了这个是未来的一个方向,也建议还在学校的同学可以考虑做这个方向的研究。make sense 5️⃣ 关于大模型没有人情味的问题。凯奇老师说现在哪怕用户的已经很生气了,大模型不会选择去安抚一下用户情绪,而是继续解决问题,这就是现状。Thomas的一个观点也不错,这是因为现在的benchmark是基于Error Rates(错误率)来建立的,也就是基准测试都是评估模型做一个事情的成功或失败这种二元评估,结果必然就是模型的目的是解决问题。我的想法也是类似这样的,我觉得这个其实也能被改变的,我们可以用一些更有活人感的数据集来做instruct,这样出来的模型会更有活人感,不够根源还是在于现状追求活人感的商业价值没那么高,等到商业价值上去了,模型厂自然会做的。 6️⃣ 关于基座模型增速放缓问题。现在其实大家还是在不同的方向上做探索,后阶段训练,RL,更高质量的数据,多模态,还是不同于的Transformer的架构,新范式等等,这些都有可能在未来出现新的突破,需要让子弹再飞一会。话说回来,这几个月也能明显感觉到模型厂已经开始上升到深耕应用层了,工程化或者说Applied AI可以在模型之外给模型公司带来第二增长曲线,并且很多实际的商业价值会在这里得到体现,这也是今年Agent市场火热的一个重要原因

大概记得这么些内容了,最后领了一个1024大礼包,还有一个后面会安排寄送的礼包,还和Thomas合了个影,还加了风龙老师的vx,风龙老师说:要是你搞语音模型,马上就挖你了(DOGE(题外话,有在学校读书研究这个方向的同学可以考虑去找风龙老师,有实习或工作机会。领大礼包的时候还和组织活动的一位同学聊了一下,上次我从厦门坐飞机特地去北京参加Google Mingling的时候也是她,很脸熟了,聊了一下。人生的轨迹就是这么神奇,之前特地去参加活动,现在来上海发展了,又再次在另一个城市的另一个活动遇见。

今天就背着送的包和公仔出街了。继续保持热情和高能量,继续保持空杯心态,继续探索未知,继续遇见一切。

Enjoy Reading This Article?

Here are some more articles you might like to read next: